自己学習型ニューラルネットワークのアルゴリズムの開発者が近年公開した重要な成功に関する

記事が、NY Times Friday号に掲載されました。 深い構造では、従来は訓練が困難であった隠された層がいくつかあります。 しかし、事前トレーニングにボルツマンマシン(RBM)のスタックを使用することで、すべてが変わりました。 その後、backpropagationメソッドを使用して重みを簡単に再構成できます。 さらに、高速GPUの出現により、これらすべてが近年見られる大きな進歩をもたらしました。

開発者自身は、1960年代にサイバネティックスを中心に盛り上がったように、ニューラルネットワークをめぐって騒動を起こさないために注目を集める声明を出していません。 それでも、この分野の研究に対する関心の復活について話すことができます。

ニューラルネットワークの研究は1960年代に積極的に行われ、その後この領域はしばらく影になりました。 しかし、2011-2012年には、音声認識、コンピュータービジョン、人工知能の分野で多くの優れた結果が示されました。 最近の成功例は次のとおりです。

•2011年、ルガノ大学の

スイスAIラボが作成したプログラムが、道路標識の認識の競争で優勝しました。 ドイツの道路標識の5万枚の画像に基づくと、他のプログラムだけでなく、競争に参加している最高の32人(99.22%)をも上回る99.46%の結果を示しました。 人々の平均は98.84%でした。 Swiss AI Labのニューラルネットワークは、手書きの漢字の最も正確な認識など、他のコンテストでも優勝しました。

•2012年の夏、Googleの専門家は1万6000個のコンピューターのクラスターを、2万個のオブジェクトに対応する1,400万枚の画像に基づいて学習する自己学習型ニューラルネットワーク用に調達しました。 認識精度はそれほど高くありませんが(15.8%)、同じような目的の以前のシステムよりもはるかに高いです。

•2012年10月に初めて、ニューラルネットワークを使用するプログラムが、新薬を開発するための統計的活性分析に関する

Merck Molecular Activity Challengeソフトウェアコンテストで優勝しました。 これは、有名なニューラルネットワークの専門家であるGeoffrey E. Hinton教授の指導の下、トロント大学のチームによって開発されました。

•2012年11月、Microsoftリサーチユニットのディレクターは、Microsoft Research Asiaの中国の21世紀コンピューティングで、音声認識、中国語への同時翻訳、別の言語でのリアルタイム音声合成を自分の声で

見事に実演しました。

1969年に発明され

たバックプロパゲーション法をニューラルネットワークのトレーニングの分野に導入したのは前述のジェフリーヒントンであると考えられていますが、その研究以前にはほとんど知られていませんでした。

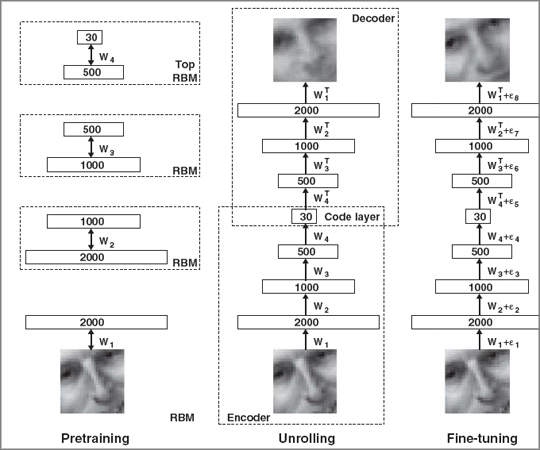

ニューラルネットワークのトレーニングにおけるブレークスルーは、ヒントンと彼の同僚であるRuslan Salakhutdinov(Ruslan Salakhutdinov)による科学記事「

ニューラルネットワークによるデータの次元の削減 」が2006年に発表された後に発生しました。 そこで彼は、ニューラルネットワークを事前にトレーニングし、ボルツマンマシンのスタック(RBM)と逆伝播法を使用してそれを微調整する手法について説明しました。 概略的に、この手法は図に示されています。

マーク・ワトソンは彼のブログで、この分野で学習を始めるための有用なリソースへの

リンクを

いくつか投稿しました。

- Courseraの機械学習用ニューラルネットワークに関するヒントンのオンラインコース。

- ディープラーニングチュートリアル 、非常に大きなプレゼンテーション(pdf、184スライド)。必要なすべての理論的基礎、数学、Pythonコード例を提供します。