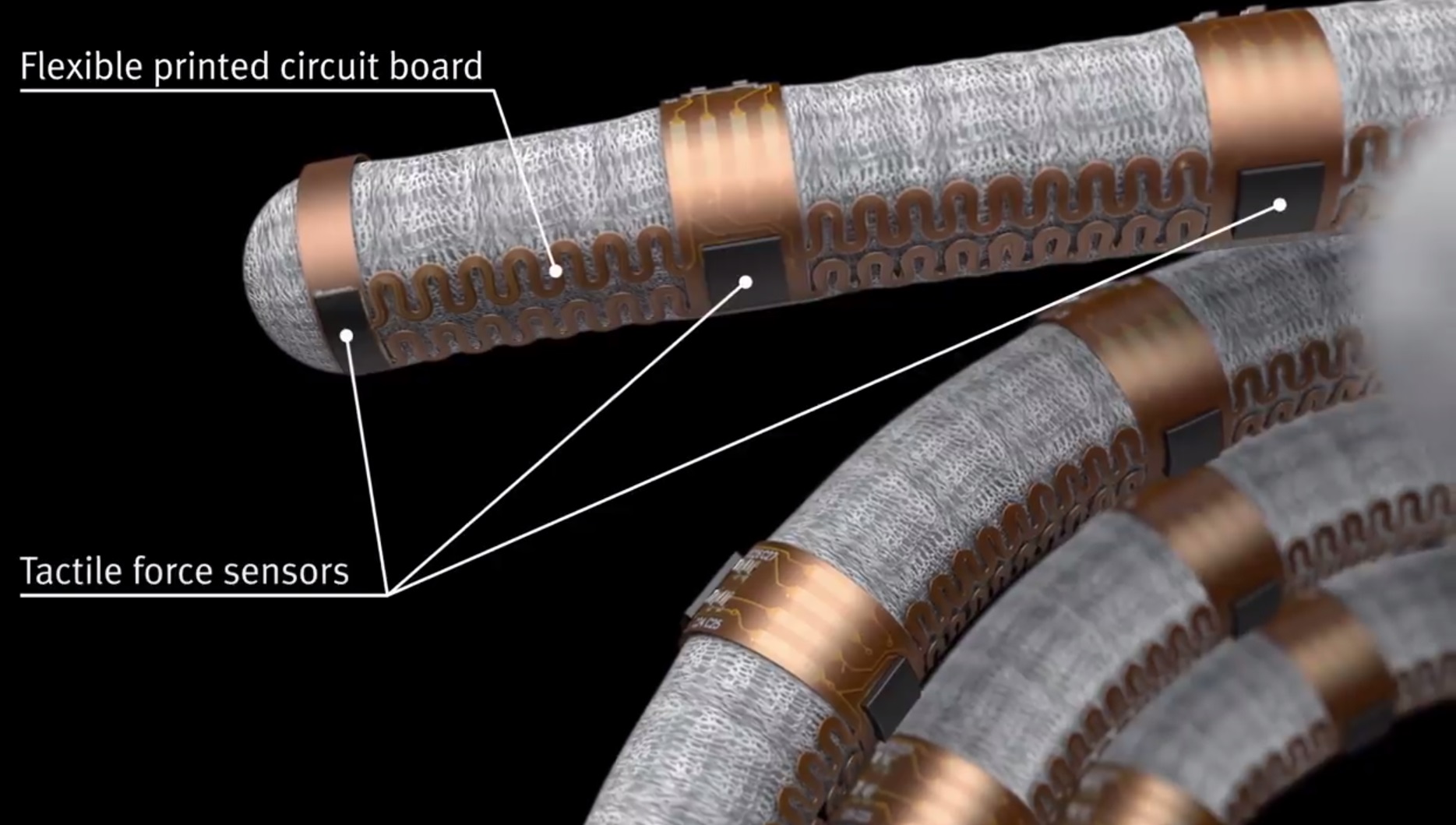

このソリューションには骨格構造がなく、手は柔らかくて柔軟な素材で作られており、指の指骨は触覚センサーと空気圧モジュールを使用して曲げることができる柔軟な導体を備えた三次元織物で作られています。 バルブ付きの結び目が手首に取り付けられ、必要に応じて手の動きを微調整して手の要素を作動させます。

BionicSoftHandの動きは、試行錯誤によって学習できる人工知能によって制御され、タスクに適応した後、人が行う方法と同様に、オブジェクトを使用して必要なアクションを迅速かつ自律的に実行します

BionicSoftHand

BionicSoftHandソリューションの製造元からの説明へのリンクは

こちらです。

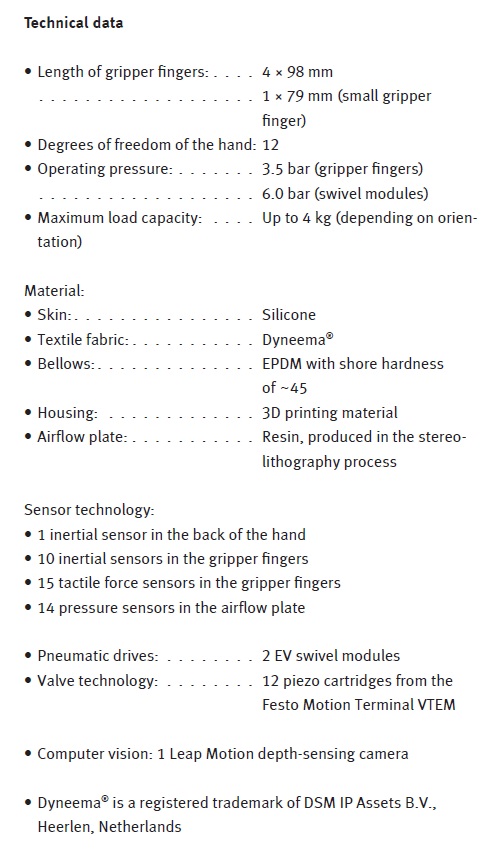

BionicSoftHandロボットアームには以下が装備されています。

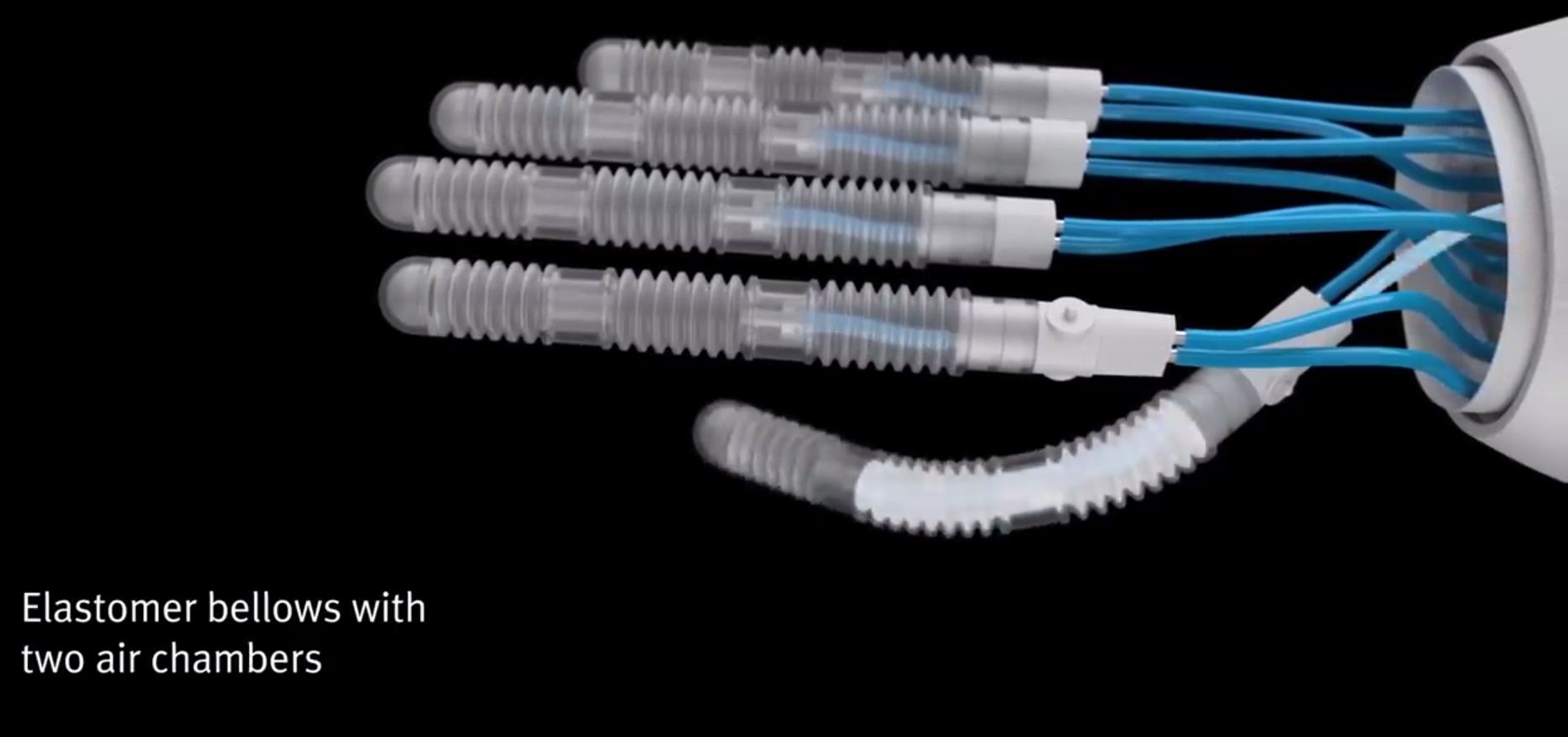

BionicSoftHandロボットアームには以下が装備されています。-筋肉や腱の働きに似た、空気がベローズに供給されると手の動きに合わせて曲がる、3Dプリンティングテクノロジーを使用して作成された弾性繊維の3次元ファブリックが周囲にある膨張式ベローズ。

-空気圧回転モジュール;

-24個のピエゾバルブ用のバルブターミナル。

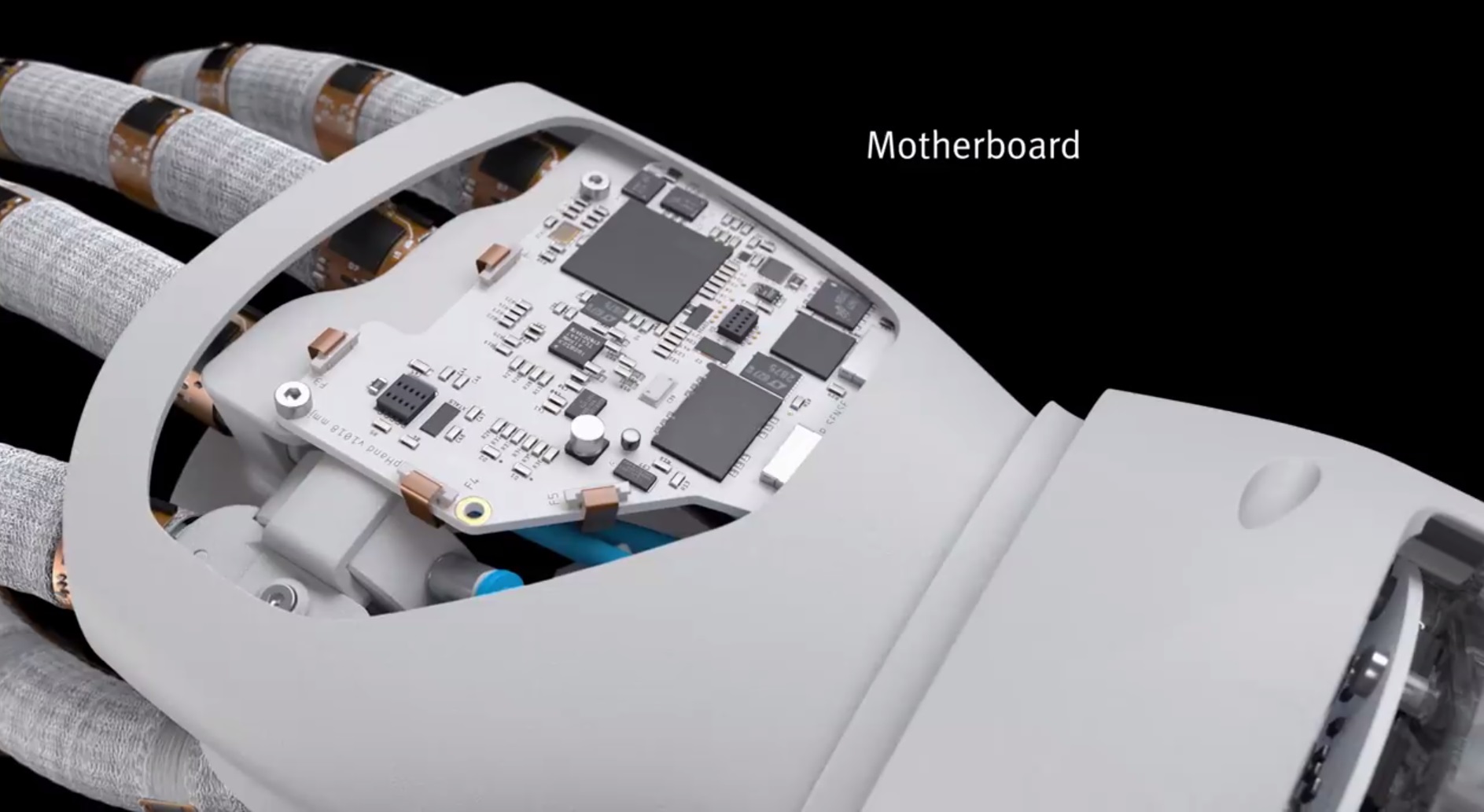

-自律モーション制御を含むオンボードマザーボード。

-柔軟な素材に基づいて作成され、動きの瞬間に曲がることができる慣性(動き)および力(柔らかい指に取り付けられた)のセンサー;

-さまざまなオブジェクトと対話し、さまざまなアクションを実行するための最良の方法を独立して計算し、最短時間で、オブジェクトと動きを分析するための深度知覚付きの3Dカメラからデータを受信できる自己学習AIモジュール。

デバイスコンポーネントの技術的特性:

手の指のタッチセンサーの配列は、手の制御システム(AIのコンポーネントを含む)にフィードバックを提供し、異なるオブジェクトと接触する方法と動きだけでなく、手と指の動きを報告し、同じAIはそれが正しいかどうかに関する情報を分析しますオブジェクトは、その操作のために手の中にあり、人の触覚を模倣する接触知覚のマトリックスを使用します。 さらに、AIは、被験者を保持するためにどのような努力をする必要があるか、指の位置と動きに対してどのような運動シーケンスを実行する必要があるか、手のひらを開く幅などを計算します。

当初、BionicSoftHandのハンドは特定の動作用にプログラムされていませんでした。制御ボードに接続されたAIは、仮想学習環境で作成する並列学習テクノロジーを使用してテストタスクを実行するプロセスで訓練され、時間とともにロボットアームが「スマート」になりますが、すでに研究され、実際のアクションで検証された動きの組み合わせを使用する新しい問題の解決策は、新しいタスクのために最適化されます。

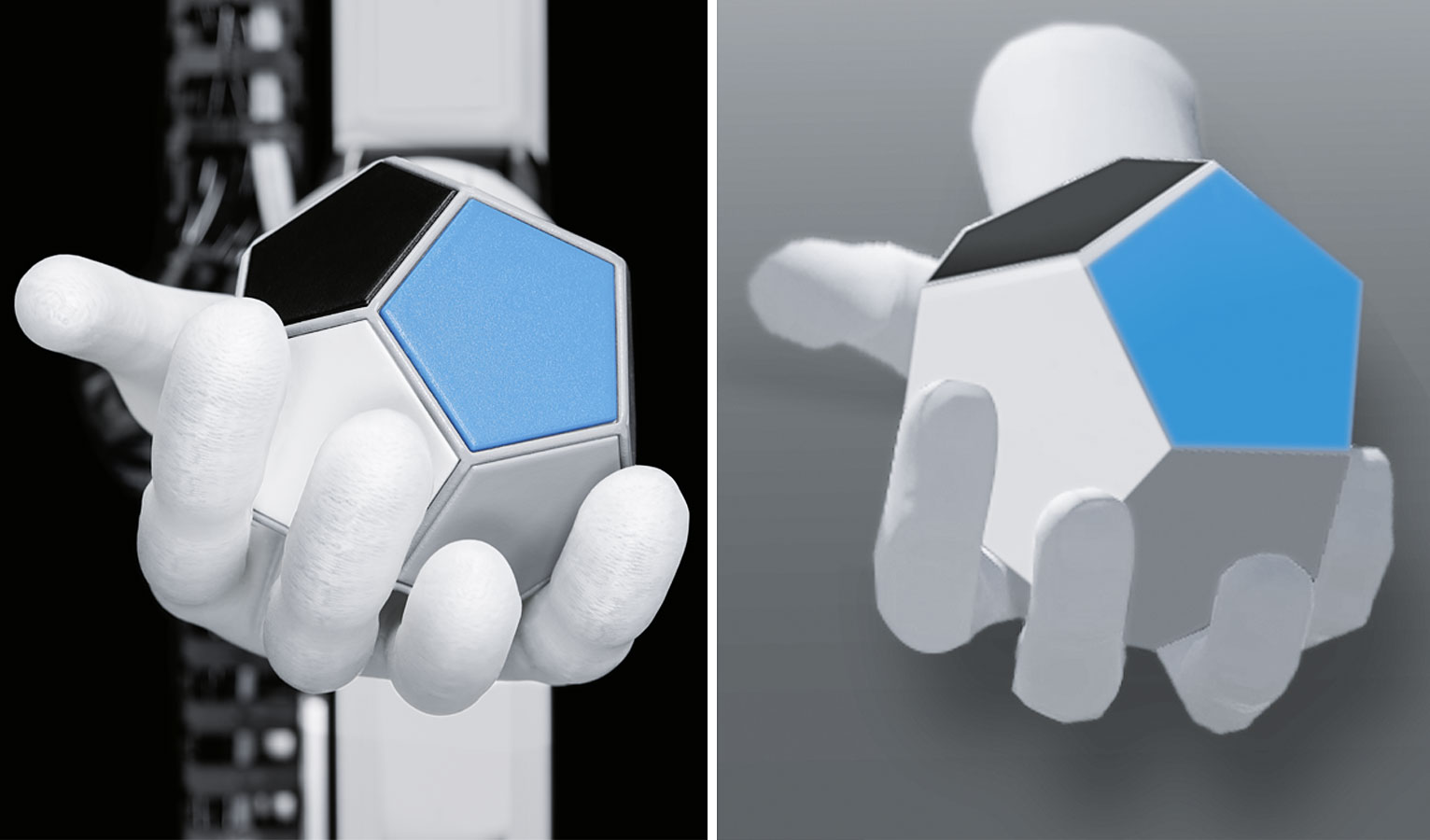

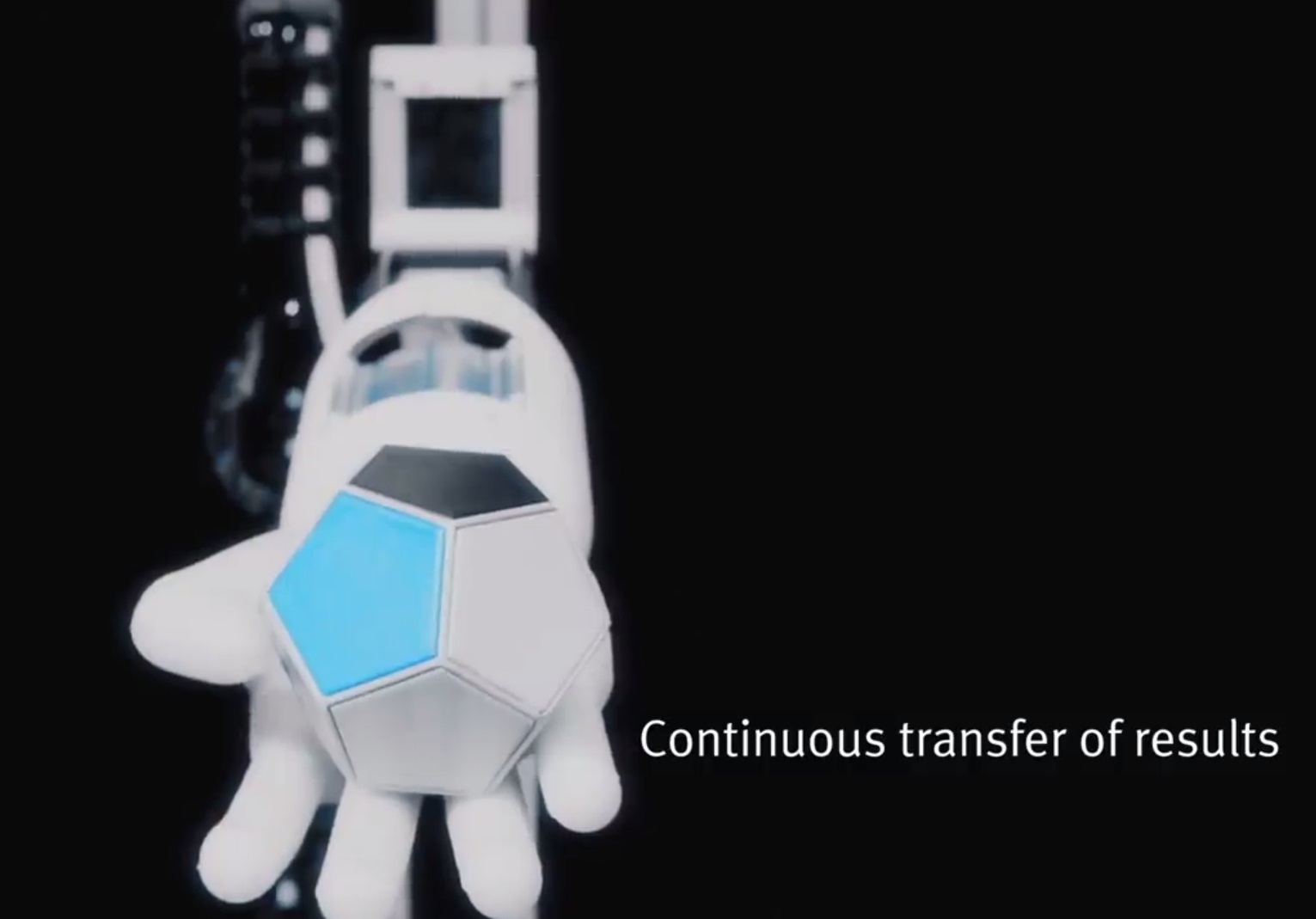

以下のデモビデオでは、ロボットアームを備えたAIに、このタスクを完了するためのアクションを説明せずに、特定の顔が見上げるように手に置かれた12面のオブジェクトを動かすタスクが与えられました。

まず、3Dカメラを使用して深度を認識し、AIはオブジェクトのデジタルコピーを作成してから、正しい組み合わせが選択されるまでオブジェクトを操作する多くの仮想ハンドで仮想シミュレーションに配置します。

次に、AIは対象との最適なアクションをすばやく見つけて実行するためのオプションを計算し、実際に実行してBionicSoftHandの要素を制御します。

より現実に近いエレクトロニクスEvgeni Veltistovを作成するためのコンポーネント。